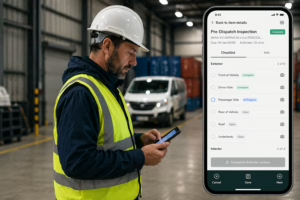

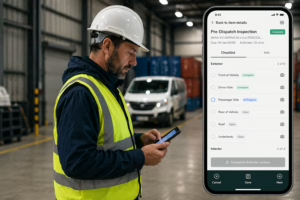

Konsequente Durchsetzung der Checkliste

Menschliche Prüfer überspringen unter Zeitdruck oder aufgrund von Müdigkeit einzelne Punkte. Sie bearbeiten Abschnitte in der falschen Reihenfolge. Sie akzeptieren zweideutige Nachweise, obwohl klarere Nachweise vorliegen.

Durch KI gestützte Arbeitsabläufe beheben dieses Problem, indem sie das Ausfüllen einer digitalen Prüfcheckliste verbindlich vorschreiben und so sicherstellen, dass jeder Schritt abgeschlossen ist, bevor der nächste durchgeführt wird.

Dies ist keine spektakuläre KI-Anwendung, aber eine der wirkungsvollsten. Die Hauptursache für Inspektionsfehler in manuellen Systemen ist nicht die Inkompetenz der Prüfer – es sind Inspektionspunkte, die inkonsistent bearbeitet oder übersprungen wurden. Die konsequente Durchsetzung der Reihenfolge der Checkliste und der Anforderungen an deren Erledigung beseitigt diese Fehlerquelle.

Automatisierte Berichterstellung

Bei manuellen Inspektionsprozessen verbringt ein Inspektor einen erheblichen Teil seiner Zeit nicht mit der Inspektion selbst, sondern mit der Erstellung von Berichten. Das Übertragen der Ergebnisse aus den Feldnotizen in einen formellen Bericht, das Formatieren von Fotos und das Verfassen von zusammenfassenden Texten – diese Aufgaben können genauso viel Zeit in Anspruch nehmen wie die Inspektion selbst.

Die automatisierte Berichterstellung macht diesen Aufwand überflüssig. Wenn ein Prüfer eine digitale Inspektion abschließt, wird der Bericht sofort aus den erfassten Daten generiert: Die Ergebnisse werden formatiert, Fotos werden mit ihren Metadaten eingebettet, und das Dokument steht innerhalb von Sekunden nach Abschluss der Inspektion zur Verfügung.

Dem Prüfer bleibt so mehr Zeit für die eigentliche Inspektion.

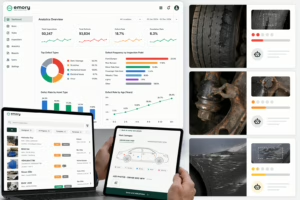

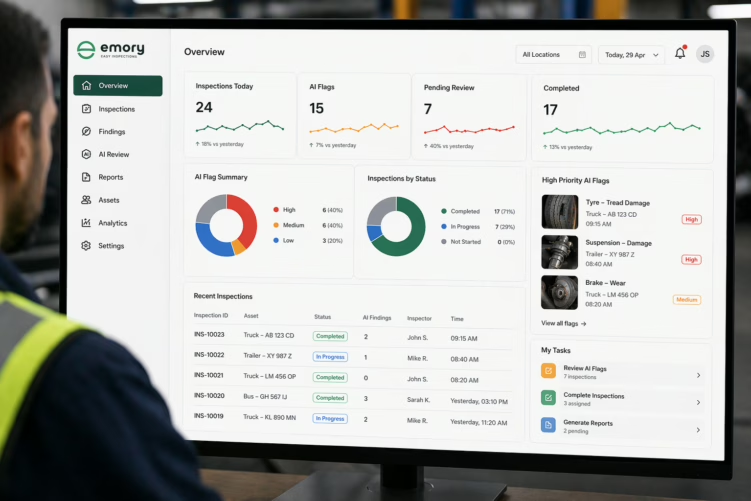

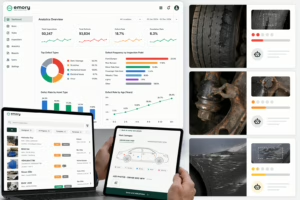

Mustererkennung in umfangreichen Inspektionsdatensätzen

Eine der leistungsstärksten Anwendungen der KI im Bereich der Inspektion ist die Analyse großer Datensätze, um Muster zu erkennen, die einem einzelnen Prüfer verborgen blieben.

Durch die Analyse Tausender Inspektionsprotokolle kann die KI ermitteln, welche Prüfpunkte am häufigsten mit Mängeln in Verbindung stehen, welche Fahrzeugtypen bei welcher Laufleistung oder welchem Alter am häufigsten ausfallen und an welchen Standorten die meisten Eskalationen auftreten.

Diese aggregierten Erkenntnisse ermöglichen eine vorausschauende Wartungsplanung, einen gezielten Einsatz von Inspektionsressourcen und Prozessverbesserungen, die sich aus einzelnen Inspektionsergebnissen nicht ableiten lassen. Ein einzelner Inspektor kann nicht 50.000 Inspektionsberichte überblicken. KI kann das.

Erkennung von Unregelmäßigkeiten in fotografischen Beweismitteln

Anwendungen der Bildverarbeitung in der Inspektion können Anomalien auf Fotos erkennen: ungewöhnliche Abnutzungsmuster, sichtbare Schäden, Verunreinigungen durch Flüssigkeiten, strukturelle Unregelmäßigkeiten.

In Umgebungen mit hohem Inspektionsaufkommen, in denen Inspektoren täglich Hunderte ähnlicher Objekte prüfen, kann Computer Vision als konsistente Zweitkontrolle dienen – und dabei Elemente aufdecken, die bei einer durch Ermüdung beeinträchtigten Inspektion übersehen werden könnten.

Diese Fähigkeit ist besonders nützlich in Fällen, in denen Mängel visuell deutlich erkennbar und konsistent sind – Oberflächenkorrosion, Flüssigkeitsflecken, sichtbare Beulen. Weniger zuverlässig ist sie in Fällen, in denen die Beurteilung von Mängeln Urteilsvermögen, Kontextwissen oder taktile Informationen erfordert, die ein Foto nicht erfassen kann.